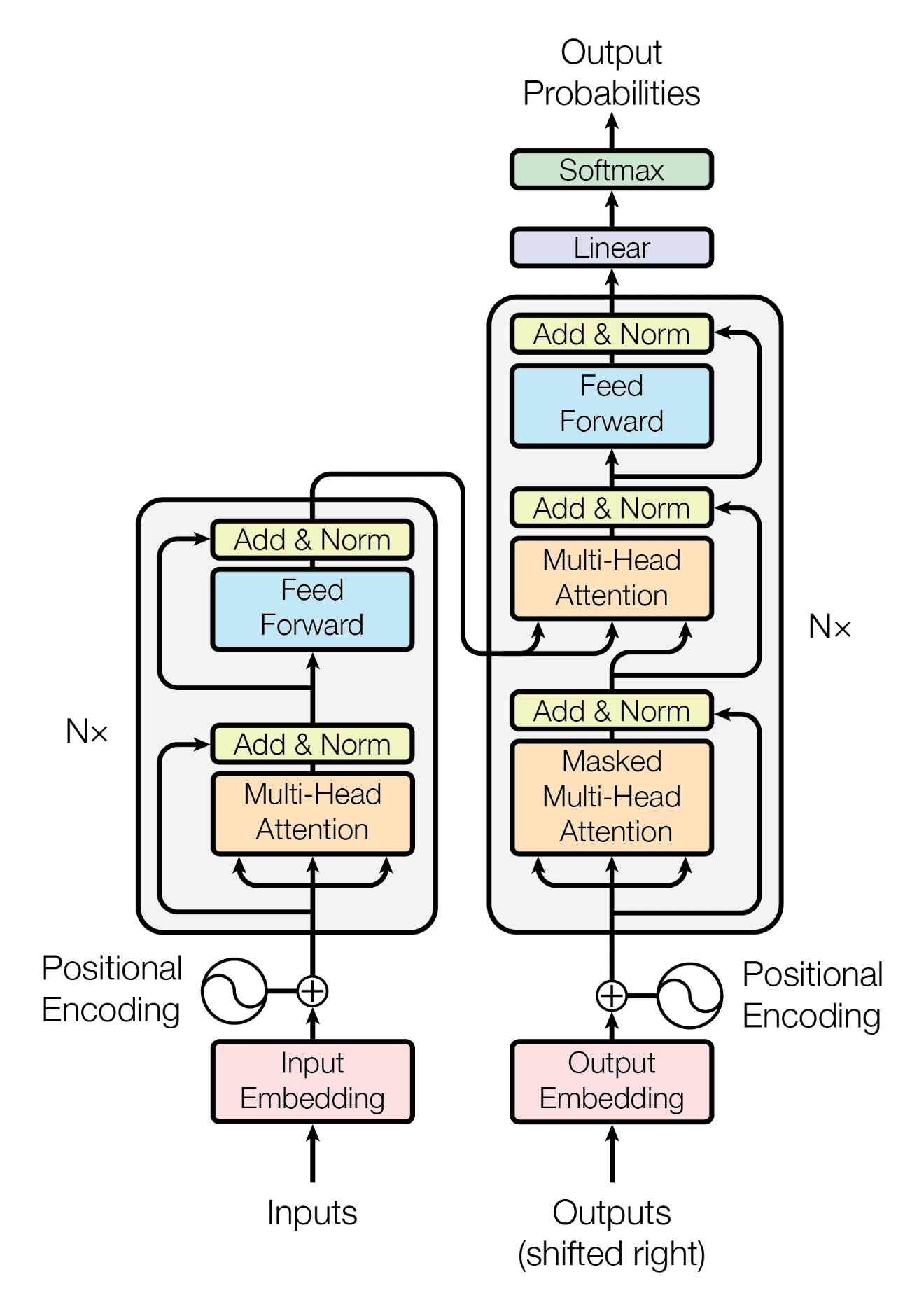

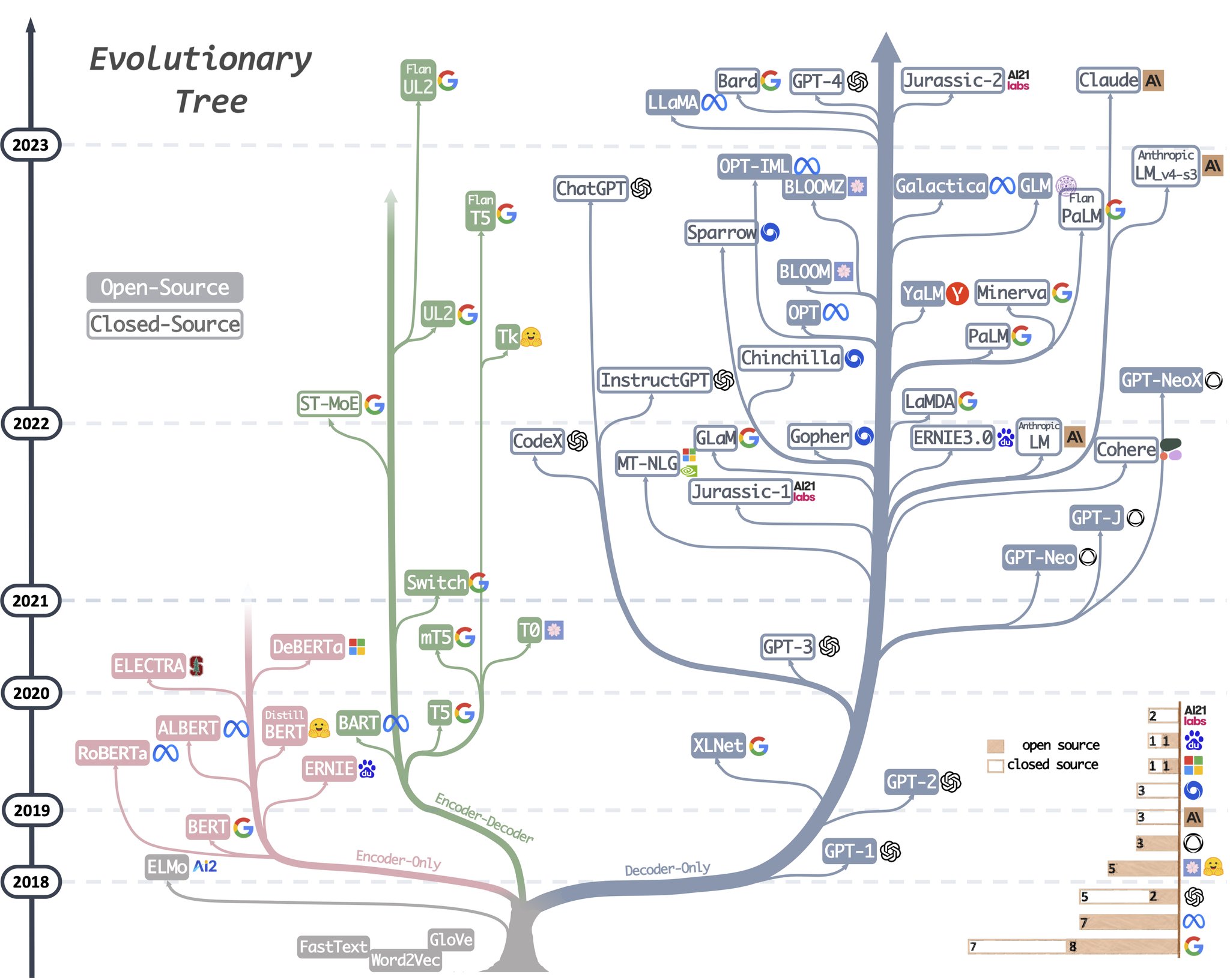

2023년 기준 NLP(Natural Language Process) 모델의 거의 대부분은 Tranformer 아키텍처를 기반으로 하며, 모델의 용도에 따라 트랜스포머의 Encoder, Decoder를 개별 또는 통합 사용하는 추세

- Encoder : 말을 잘 이해하게 하는 부분

- Decoder : 말을 잘 하게 하는 부분

- Closed

- Good : 뛰어난 성능, API 방식의 편리한 사용성

- Bad : 보장할 수 없는 보안, API 호출 비용

- Open

- Good : Closed 못지 않는 성능, 높은 보안성, 낮은 비용

- Bad : 개발 난이도 높음, 사용 위한 GPU 서버 필요 (비용 발생 요인)

| 구분 | 개발사 | 모델 |

|---|---|---|

| Closed | OpenAI | GPT-3, GPT-3.5, GPT-4 |

| Closed | PALM, LaMDA, Bard | |

| Open | Meta | LLaMA, LLaMA2 |

| Open | Upstage | upstage-llama2 |

| Oepn | MosaicML | MPT-7B |

- 유튜브 모두의AI - 'Langchain 강의 - LLM 초간단 설명'